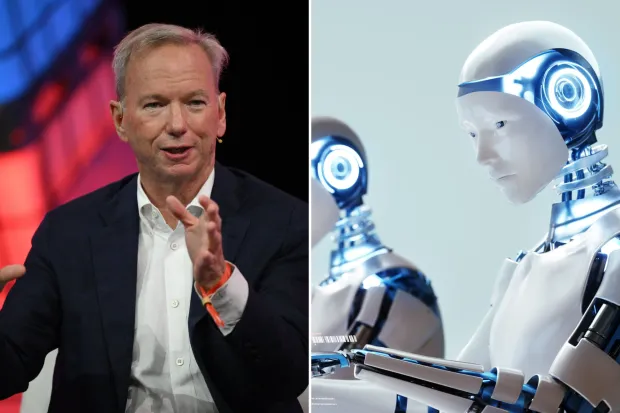

Искусственный интеллект: шанс или угроза? Бывший глава Google предупреждает о рисках

Искусственный интеллект (ИИ) продолжает развиваться с беспрецедентной скоростью, но вместе с прогрессом растут и опасения. Эрик Шмидт, бывший генеральный директор Google, выразил тревогу относительно будущего ИИ, заявив, что в определённый момент люди могут утратить контроль над технологиями.

В интервью для программы This Week на канале ABC Шмидт подчеркнул, что, когда компьютерные системы достигнут способности к самосовершенствованию, человечеству необходимо будет серьезно задуматься о том, чтобы «отключить их».

Он отметил, что нынешний прогресс ИИ вызывает восторг. Однако, по его словам, независимость машин становится реальной угрозой:

«В скором времени компьютеры смогут работать автономно и сами решать, что они хотят делать».

Эта автономность несёт как огромный потенциал, так и серьёзные риски. По мнению Шмидта, дать каждому человеку в карман «эквивалент полимата» может оказаться опасным.

По словам экспертов, системы ИИ уже к 2026 году могут достичь уровня интеллекта, сопоставимого с доктором наук. Это открывает новые горизонты, но также ставит вопрос: как справляться с такой мощной технологией?

Шмидт уверен, что контроль над ИИ должен быть частью глобальной стратегии:

«Худшие сценарии должны быть предсказаны заранее, а параллельные системы разработаны для мониторинга первых».

Он также подчеркнул важность того, чтобы Запад оставался лидером в гонке технологий, несмотря на активное развитие ИИ в Китае.

Эксперты, такие как Ришабх Мисра, предупреждают, что даже малейшая ошибка в конфигурации ИИ или злонамеренные действия могут привести к катастрофическим последствиям.

Возможные сценарии включают:

- Распространение дезинформации и разжигание ненависти.

- Влияние на финансовые рынки и обрушение экономик.

- Использование ИИ для управления транспортом или оружием в целях нанесения вреда.

- Создание дипфейков, способных разрушить репутацию или даже спровоцировать войны.

На федеральном уровне в США уже ведутся обсуждения о необходимости регулирования ИИ. Эффектное появление ChatGPT в 2022 году ускорило развитие технологий, но также выявило уязвимости.

Многие эксперты, включая Эйтана Майкла Азоффа, автора книги Towards Human-Level Artificial Intelligence, считают, что для управления ИИ необходимо лучше понять «нейронный код» – способ, которым наш мозг обрабатывает информацию и решает задачи.

Шмидт предложил любопытное решение:

«Люди не смогут контролировать ИИ, но ИИ должен контролировать сам себя».

Это поднимает философский вопрос: сможет ли машина не только подчиняться, но и исправлять свои ошибки?

Вместе с огромными возможностями ИИ несёт новые вызовы, требующие ответственного подхода. Быть на шаг впереди в развитии технологий и разрабатывать эффективные механизмы контроля — ключевые задачи для всего человечества.